实验记录

An Efficient Framework for Clustered Federated Learning

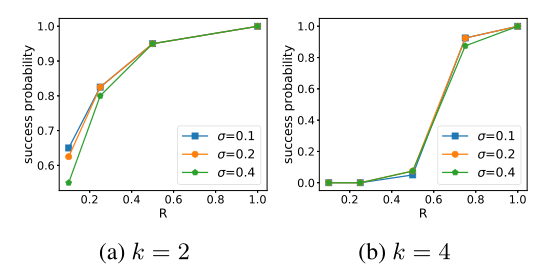

分离尺度越大,成功概率越大

数据越多,client越多,成功概率越大

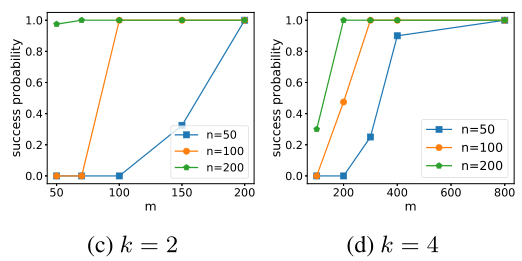

MNIST and CIFAR 数据集

对于给定的m和n,满足mn=60000k (k类别数)

我们将图像随机划分为m个工作机器,使每台机器拥有n个相同旋转的图像

我们注意到,通过操纵MNIST和CIFAR-10等标准数据集来创建不同的任务已经被持续学习研究界广泛采用[11,15,24]。对于集群FL,使用旋转创建数据集有助于我们模拟具有清晰集群结构的联邦学习设置。

在我们的MNIST实验中,我们使用了带有ReLU激活的全连接神经网络,其中一个隐藏层大小为200;在CIFAR实验中,我们采用了由两个卷积层和两个完全连通层组成的卷积神经网络模型,并对图像进行了翻转和随机裁剪等标准数据增强预处理。

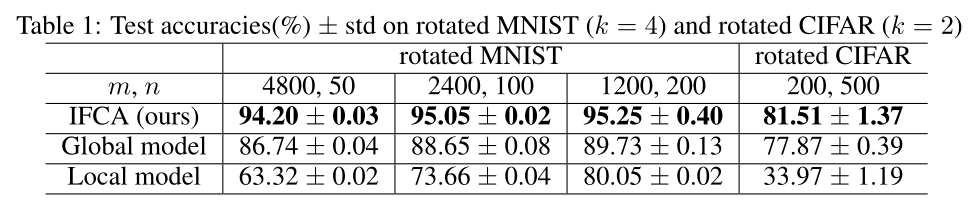

我们认为FEMNIST可能没有一个非常清晰的聚类结构,因此基于聚类的方法可能不是最合适的。对于实际应用,我们建议使用最适合数据分布的算法。

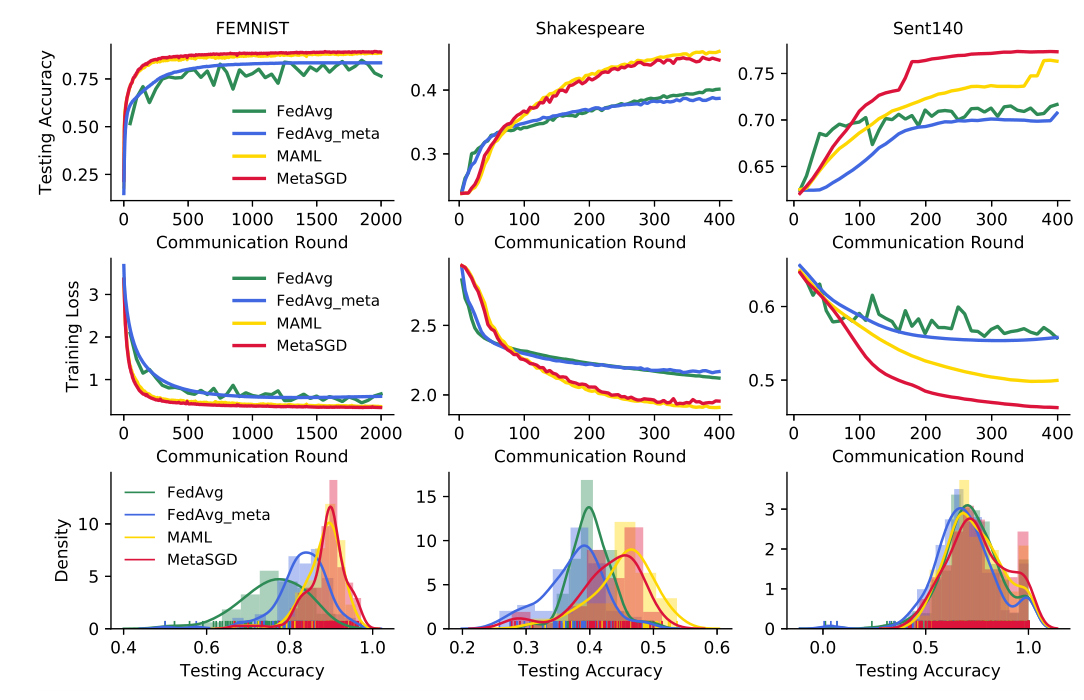

Federated Meta-Learning with Fast Convergence and Efficient Communication

FEMNIST CNN

Shakespeare a stacked character-level LSTM model

Sent140 LSTM classifier

最后

以上就是幽默饼干最近收集整理的关于实验记录总结的全部内容,更多相关实验记录总结内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

![Failed to apply plugin [id 'com.android.application']](https://www.shuijiaxian.com/files_image/reation/bcimg12.png)

发表评论 取消回复