总结下训练神经网络中最最基础的三个概念:Epoch, Batch, Iteration。

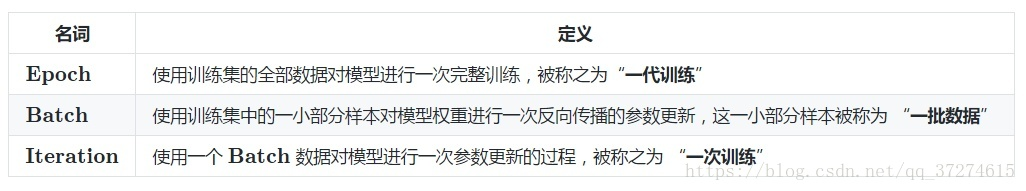

1. 名词解释

- epoch:训练时,所有训练数据集都训练过一次。

- batch_size:在训练集中选择一组样本用来更新权值。1个batch包含的样本的数目,通常设为2的n次幂,常用的包括64,128,256。

网络较小时选用256,较大时选用64。 - iteration:训练时,1个batch训练图像通过网络训练一次(一次前向传播+一次后向传播),每迭代一次权重更新一次;测试时,1个batch测试图像通过网络一次(一次前向传播)。所谓iterations就是完成一次epoch所需的batch个数

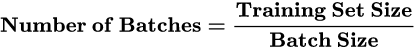

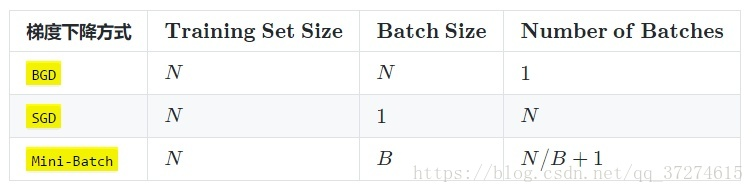

2. 换算关系

实际上,梯度下降的几种方式的根本区别就在于上面公式中的 Batch Size不同。

*注:上表中 Mini-Batch 的 Batch 个数为 N / B + 1 是针对未整除的情况。整除则是 N / B。

3. 示例

CIFAR10 数据集有 50000 张训练图片,10000 张测试图片。现在选择 Batch Size = 256 对模型进行训练。

- 每个 Epoch 要训练的图片数量:50000 训练集具有的 Batch 个数:50000 / 256 = 195 + 1 = 196

- 每个 Epoch 需要完成的 Batch 个数:196

- 每个 Epoch 具有的 Iteration 个数:196

- 每个 Epoch中发生模型权重更新的次数:196

- 训练 10 代后,模型权重更新的次数:196 * 10 = 1960

- 不同代的训练,其实用的是同一个训练集的数据。第 1 代和第 10

代虽然用的都是训练集的五万张图片,但是对模型的权重更新值却是完全不同的。因为不同代的模型处于代价函数空间上的不同位置,模型的训练代越靠后,越接近谷底,其代价越小。

最后

以上就是缥缈电源最近收集整理的关于卷积神经网络训练三个概念(epoch,迭代次数,batchsize)1. 名词解释2. 换算关系3. 示例的全部内容,更多相关卷积神经网络训练三个概念(epoch,迭代次数,batchsize)1.内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复