Tensorflow2.0——Overfitting

- Overfitting

- regularization/weight decay

- 动量与学习率

- momentum动量

- learning rate decay

- Early Stopping

- dropout

- Stochastic Gradient Descent

Overfitting

解决办法:

1.增加数据量

2.降低模型复杂度:控制网络结构、增加正则项(惩罚项)

3.dropout

4.数据增强

5.测试数据在过拟合前停止迭代

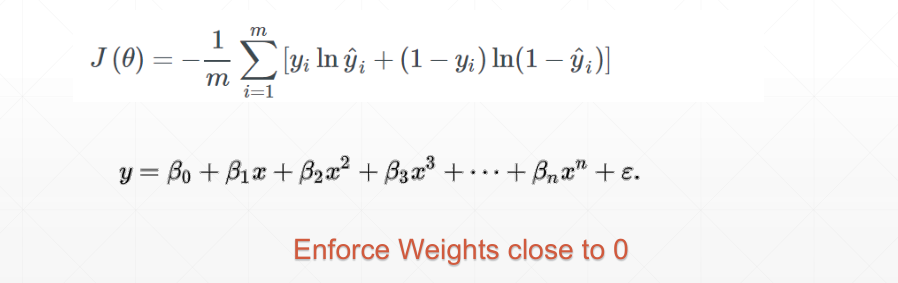

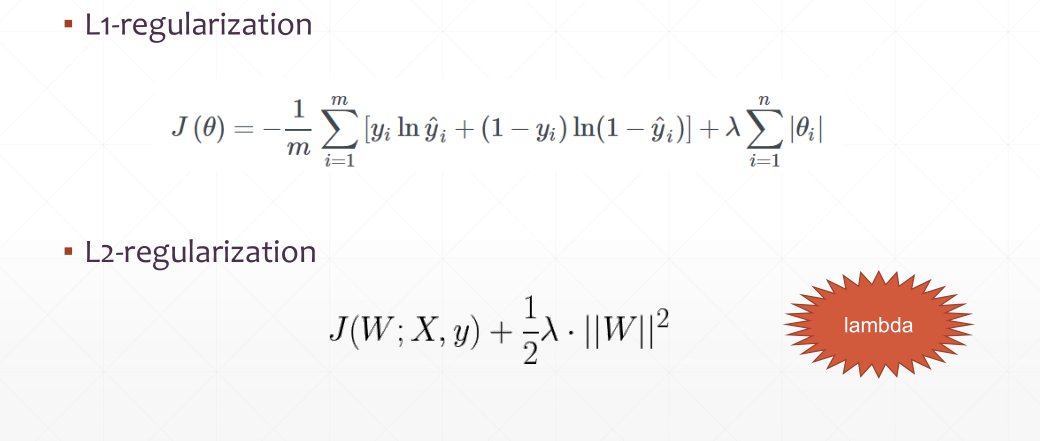

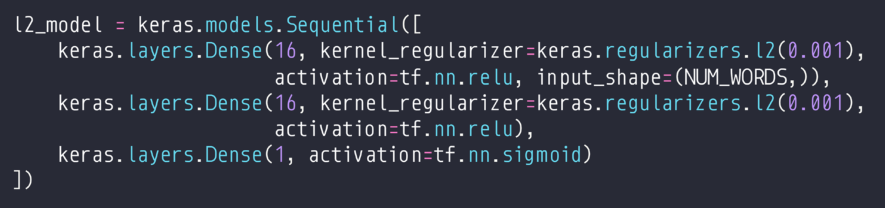

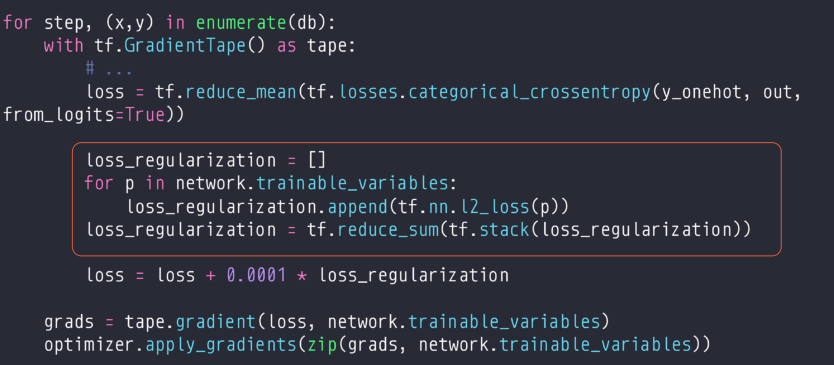

regularization/weight decay

两种类型

即增加正则项,如果模型存在过拟合现象,使用weight_decay可以很好地解决过拟合现象,但如果模型解释能力正好,再使用weight_decay就很大地减弱了模型的能力。

即增加正则项,如果模型存在过拟合现象,使用weight_decay可以很好地解决过拟合现象,但如果模型解释能力正好,再使用weight_decay就很大地减弱了模型的能力。

[one_by_one regularization]

[flexible regularization]

动量与学习率

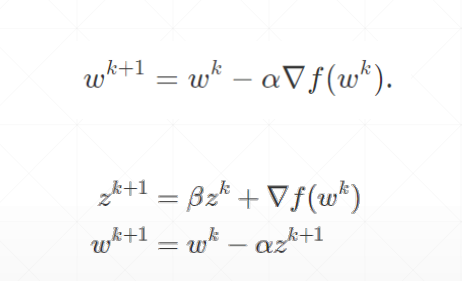

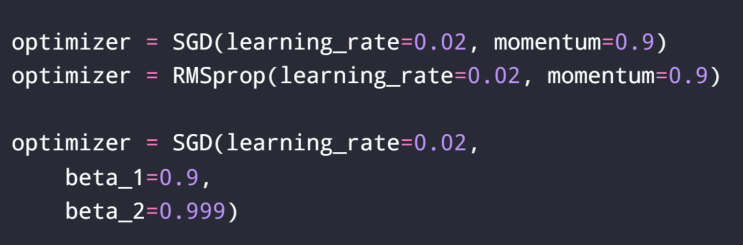

momentum动量

为小球加一个惯性量。

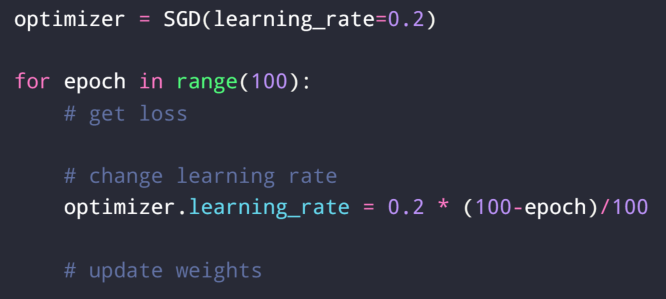

learning rate decay

自适应:根据迭代次数降低学习速率。

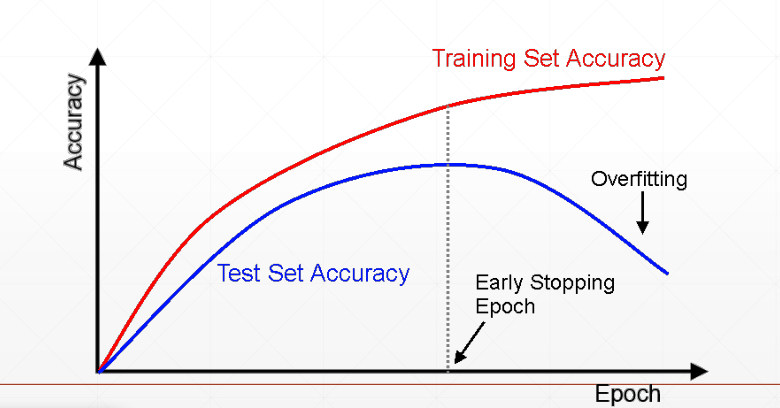

Early Stopping

选择能够使验证集精度最高的迭代次数。

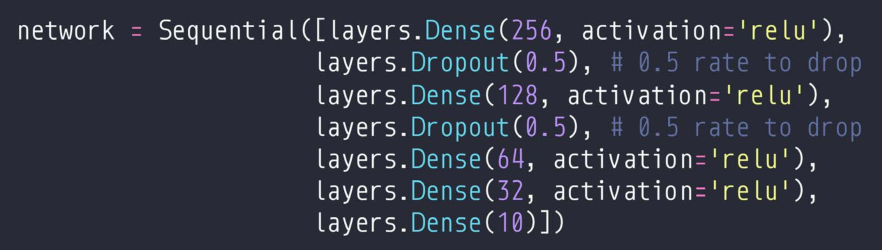

dropout

不使网络全连接。在层与层之间加入dropout。

Stochastic Gradient Descent

取一个batch计算误差更新梯度。

最后

以上就是专注帆布鞋最近收集整理的关于Tensorflow2.0——过拟合问题Overfitting的全部内容,更多相关Tensorflow2内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复